2023年数据中心液冷行业发展现状及趋势深度分析

随着人工智能、云计算、大数据以及区块链等技术的创新发展,使得数据资源的存储、计算和应用需求快速扩张,特别是ChatGPT技术推广进一步催生了AI算力等大功率应用场景加速落地。作为信息基础设施的数据中心及通信设备承担的计算量越来越大,对计算效率的要求也越来越高,国内包括全球的数据中心建设有望迎来建设高峰。为了应对网络处理性能的挑战,数据中心服务器及通信设备不断提升自身处理能力和集成度,带来了功率密度的节节攀升。这些变化除了带来巨额能耗问题以外,高热密度也给制冷设备和技术提出了更高要求。传统风冷技术面对高热密度场景呈现瓶颈,散热效率已经跟不上计算效率。在此背景下,液冷技术以其超高能效、超高热密度等特点引起行业的普遍关注,是解决散热压力和节能挑战的必由之路。

下面我们将主要介绍液冷行业的概念、分类与驱动因素等内容,并针对液冷行业上下游产业链进行详细梳理,并对未来市场进行展望,希望对大家了解液冷行业有所启发。

一、液冷行业概述

1、液冷概念及作用

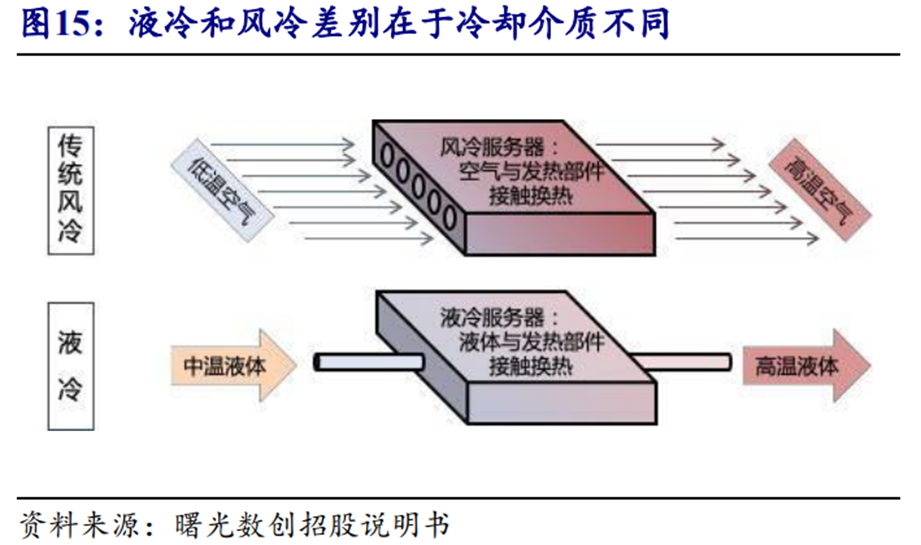

液冷主要指的是利用液体替代空气,带走CPU、芯片组、内存条以及扩展卡等发热器件运行时产生的热量。

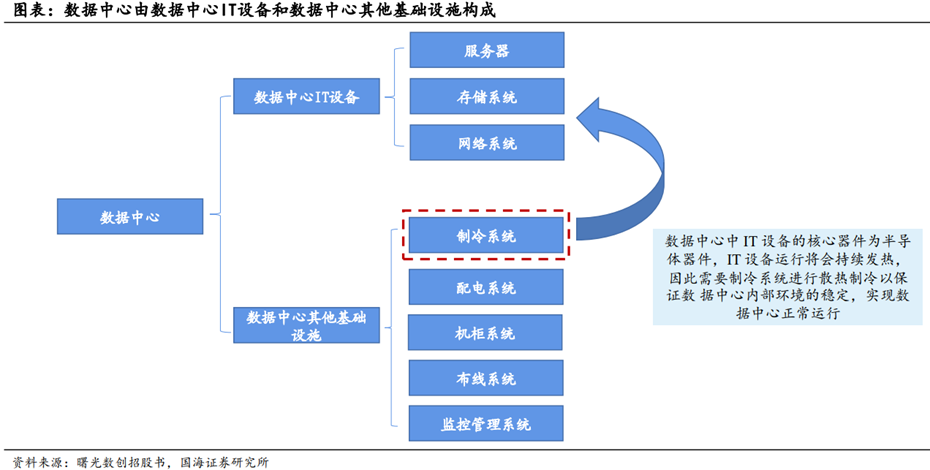

液冷能够为数据中心中的IT设备散热制冷,实现数据中心正常运行。数据中心(DataCenter,简称DC),即为集中放置的电子信息设备提供运行环境的建筑场所,包括主机房、辅助区、支持区和行政管理区等。作为人工智能、5G、云计算、工业互联网的底层算力基础设施,数据中心的价值大幅凸显。组成数据中心的基础设施包括服务器、光模块等IT设备及电源、制冷、机柜等非IT设备。制冷系统是数据中心基础设施的重要组件。数据中心中IT设备的核心器件为半导体器件,IT设备运行将会持续发热,因此需要制冷系统进行散热制冷以保证数据中心内部环境的稳定,实现数据中心的正常运行。其中制冷系统采用的冷却技术就包含液冷冷却。

2、液冷技术分类

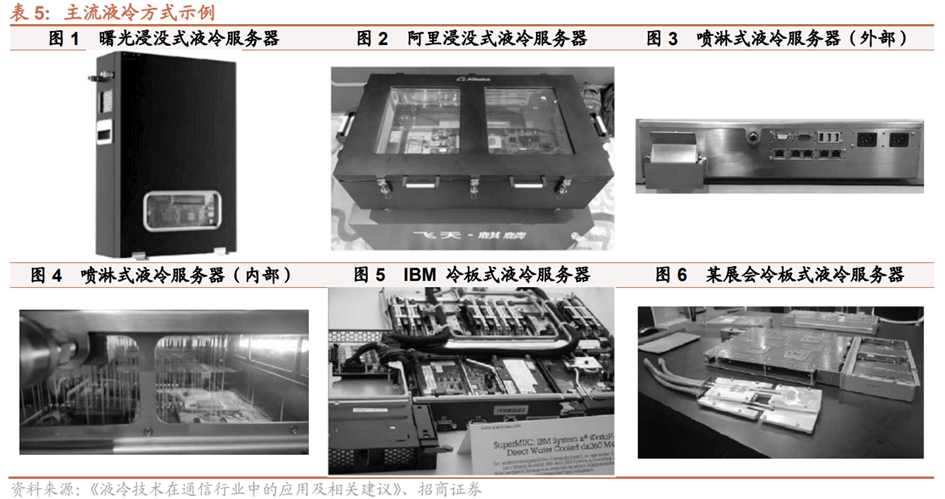

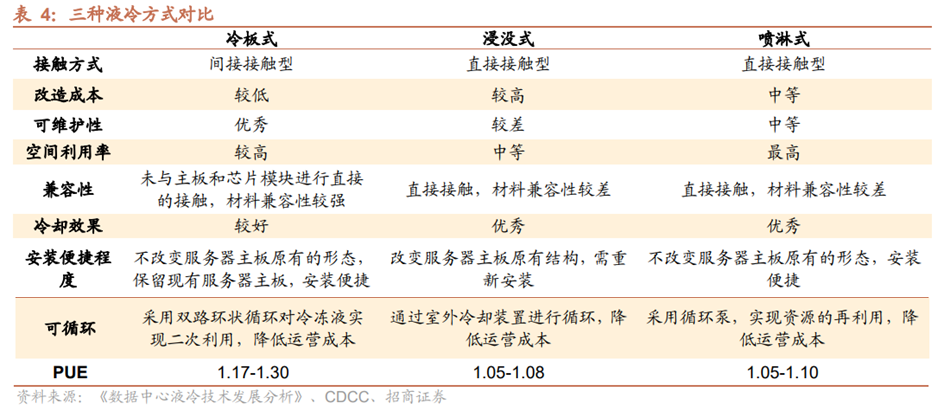

冷却技术包含风冷冷却、水冷冷却、自然冷却及液冷冷却等技术。其中液冷技术按照液体与发热器件的接触方式,可分为“间接接触型”和“直接接触型”两大类。浸没式和喷淋式液冷等为接触式液冷,冷板式液冷为非接触式液冷。

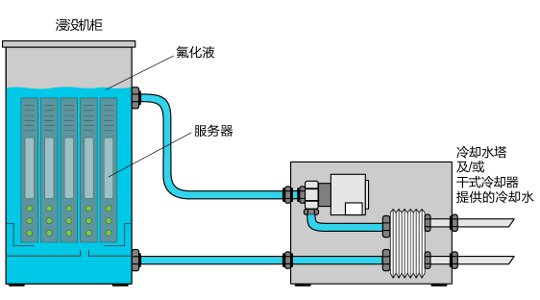

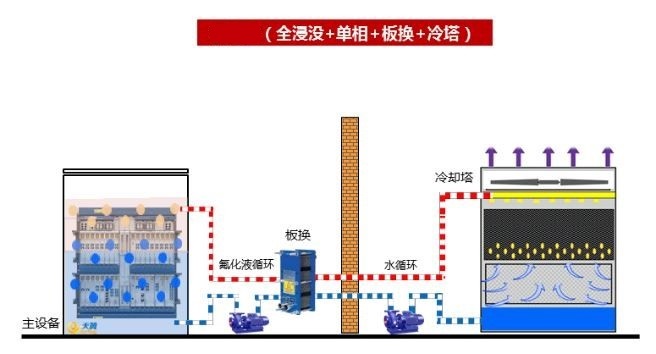

(1)浸没式液冷:浸没式液冷将IT设备发热元件全部浸没在冷却液中实现散热,根据工质是否产生相变又分为单相液冷和相变液冷。吸热后的冷却液采用风冷或水冷等方式循环冷却或者冷凝。

(2)喷淋式液冷:喷淋式液冷依靠泵压或重力驱动,按发热元件需求向IT设备电路板自上而下精准喷淋冷却液,吸热的冷却液采用风冷或水冷等方式循环冷却。

(3)冷板式液冷:冷板式液冷为非接触式液冷,冷却液体与发热器件不会直接接触。冷板式液冷通过流道将冷却液通往与IT设备发热元件接触的冷板将热量导出,吸热后的冷却液通过风冷或水冷等方式循环冷却。

3、液冷方式对比

冷板式液冷成熟度最高,浸没式液冷、喷淋式液冷节能效果更优。目前,3种不同液冷中,冷板式液冷发热器件不需接触冷却液,发展时间最早,技术成熟度较高,冷板式液冷采用微通道强化换热技术具有极高的散热性能,在军用雷达、高密度数据中心、高性能电脑、动力电池以及高功率LED散热领域均有应用,是解决大功耗设备部署、提升能效、降低制冷运行费用、降低TCO的有效应用方案;而浸没式和喷淋式液冷实现了100%液体冷却,具有更优的节能效果。浸没式液冷散热节能优势明显,在超算、高性能计算领域取得了广泛应用;喷淋式液冷公开展示的研究成果和应用实践相对较少。

4、与风冷相比液冷的优势

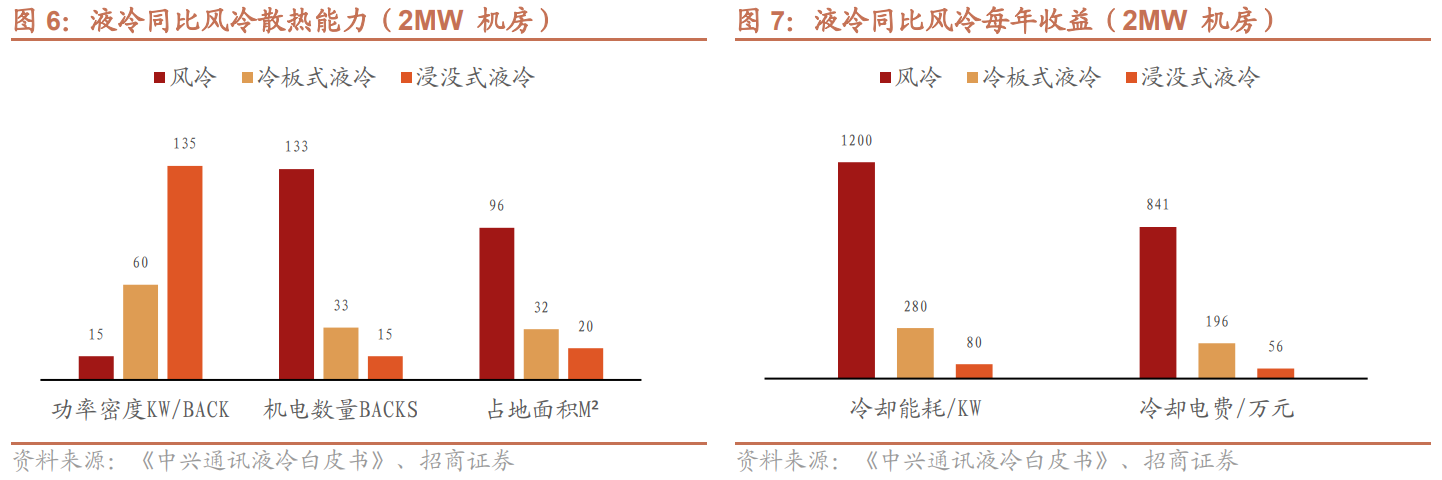

相较于风冷,液冷具有低能耗、高散热、低噪声、低TCO等优势。液体的冷却能力是空气的1000~3000倍。液冷技术可实现高密度、低噪音、低传热温差以及普遍自然冷却等优点,相对于风冷技术具有无法比拟的技术优势,是一种可以适用于需要大幅度提高计算能力、能源效率和部署密度等场景的优秀散热解决方案。

(1)低能耗

传热路径短,低温液体由CDU(冷量分配单元)直接供给通讯设备内,换热效率高,具备更优的换热效果。同时制冷能效高,液冷技术可实现40~55℃高温供液,无需压缩机冷水机组,采用室外冷却塔,可实现全年自然冷却;除制冷系统自身的能耗降低外,采用液冷散热技术有利于进一步降低芯片温度,芯片温度降低带来更高的可靠性和更低的能耗,整机能耗预计可降低约5%。

(2)高散热

液冷系统常用介质有去离子水、醇基溶液、氟碳类工质、矿物油或硅油等多种类型;这些液体的载热能力、导热能力和强化对流换热系数均远大于空气;因此,针对单芯片,液冷相比于风冷具有更高的散热能力。同时,液冷直接将设备大部分热源热量通过循环介质带走;单板、整柜、机房整体送风需求量大幅降低,允许高功率密度设备部署;同时,在单位空间能够布置更多的ICT设备,提高数据中心空间利用率、节省用地面积。

(3)低噪声

液冷散热技术利用泵驱动冷却介质在系统内循环流动并进行散热,解决全部发热器件或关键高功率器件散热问题;能够降低冷却风机转速或者采用无风机设计,从而具备极佳的降噪效果,提升机房运维环境舒适性,解决噪声污染问题。

(4)低TCO

液冷技术具有极佳的节能效果,液冷数据中心PUE(即电能利用效率,是数据中心消耗的所有能源与IT负载消耗的能源比值。PUE值越高,数据中心的整体效率越低。)可降至1.2以下,每年可节省大量电费,能够极大的降低数据中心运行成本。相比于传统风冷,液冷散热技术的应用虽然会增加一定的初期投资,但可通过降低运行成本回收投资。

二、液冷行业现状及趋势

1、我国IDC温控市场空间持续扩容,目前风冷仍占主导地位

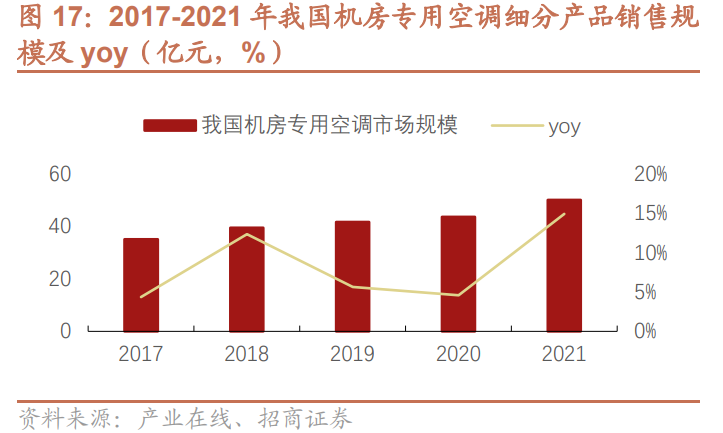

目前我国行业数字化转型进度不断加快,推动IDC温控市场发展。根据产业在线,我国机房专用空调市场2021年CAGR达9.28%,呈现快速增长态势,2021年市场规模达50.09亿元,同比增长14.9%,其中,按空调制冷方式来看,2021年风冷、冷冻水和其他形式空调的占比分别为56.8%/30.81%/12.39%,风冷仍旧占主导地位。

2、液冷方案将成为未来主流

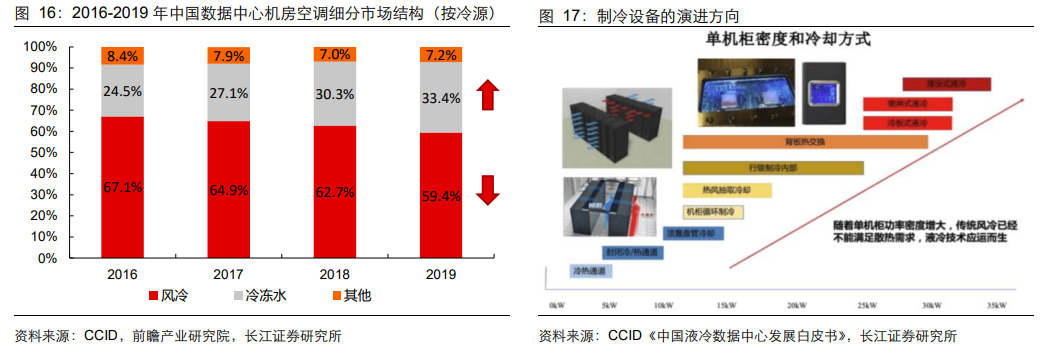

近年来,风冷型机房占有率逐年下滑,液冷技术凭借多项优势,预计未来在数据中心中渗透率将持续提升,成为主流使用的冷却技术。

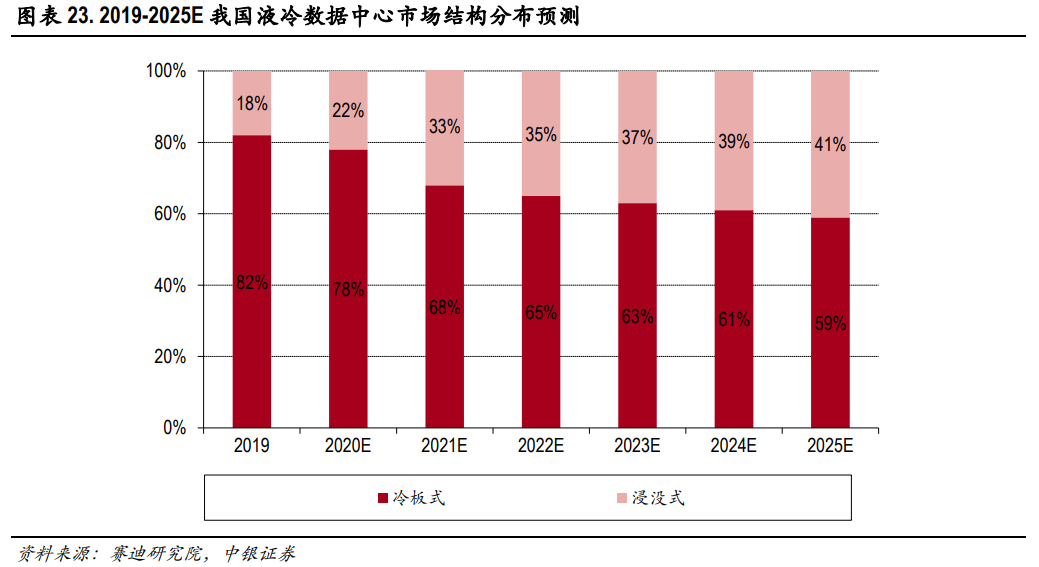

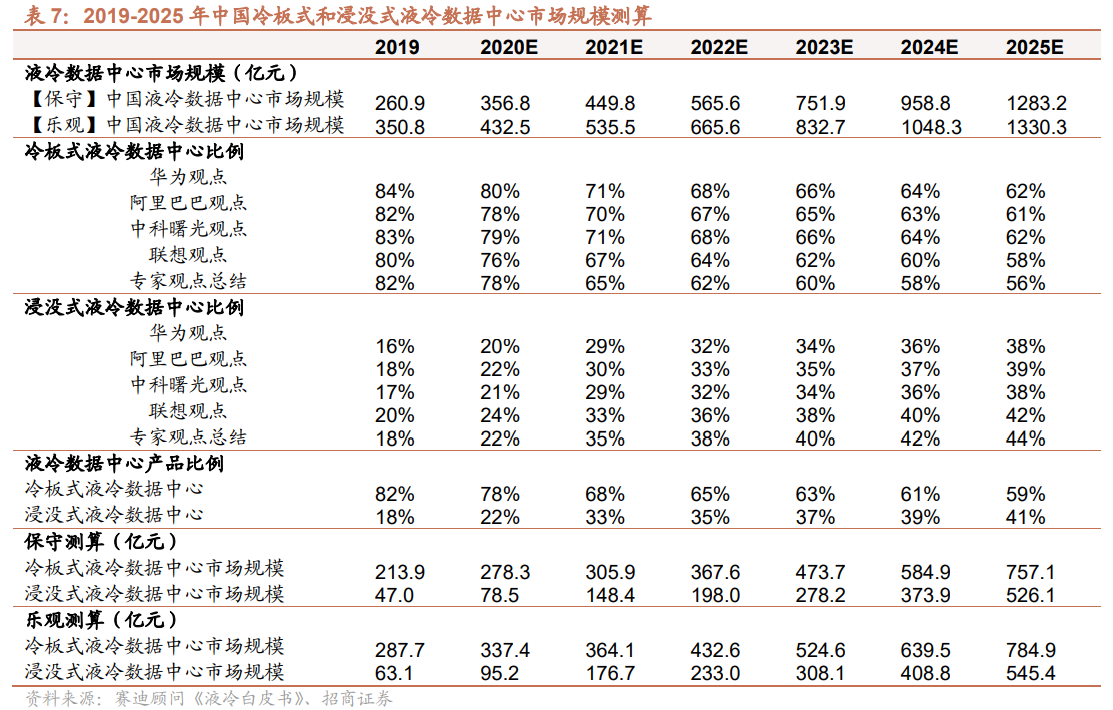

3、未来浸没式液冷技术逐渐成熟,有望成为主流

目前冷板式技术成熟,领衔商用落地。据前瞻产业研究院数据,2019年我国液冷数据中心技术主要以冷板式为主,占比超过80%,浸没式占比不足20%。而浸没式制冷效率更高,成为主流厂商目前的研发重点,是数据中心的跃迁式技术创新,预计随着技术方案的不断成熟,浸没式将成为更重要的主流解决方案。

三、液冷行业发展的驱动因素

1、单柜功率提升是液冷技术渗透的根本原因

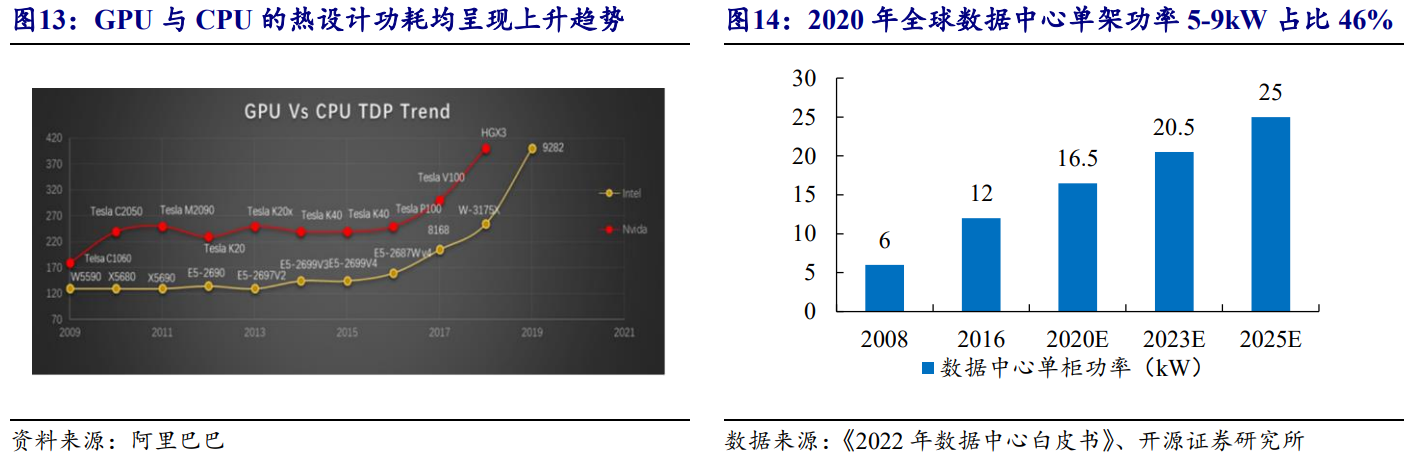

根据微软数据,ChatGPT前一代基础模型-GPT3.0的训练数据高达45TB,总训练设备包括28.5万个CPU与超过1万个NVIDIA V100 GPU。随着国内百度、阿里巴巴、腾讯、华为、360、字节等互联网大厂陆续推出自己的AIGC算力模型,势必会对国内AI服务器的需求快速增加,AI服务器中大量使用高功率CPU、GPU芯片,带动整台AI服务器功率和热密度提升。(1)CPU功耗持续提升:随着内核数量的增加,处理器性能与功率实现了同步增长,这也直接导致了CPU热流密度的相应增加和服务器机柜本内部的总体热密度增加;(2)GPU使用日益增加:GPU由数百个内核组成,可同时处理数千个线程,相应地功耗更高。(3)低延迟需求导致热密度增加:随着服务器组件性能的提高,不同组件之间的互连在延迟方面开始成为瓶颈。为了充分利用提升的组件性能,CPU、GPU和板卡上的其他组件被更加紧密的安排以减少延迟,这同样提升了服务器内部的物理密度和温度越来越高。

同时根据ODCC《冷板式液冷服务器可靠性白皮书》相关信息,在摩尔定律变缓的大背景下,芯片算力与其功耗同步出现了大幅提升。2022年Intel第四代服务器处理器单CPU功耗已突破350瓦,英伟达单GPU芯片功耗突破700瓦。持续进步的IT技术和算力能耗功率使得数据中心承载能力要求被不断提升。

因此提升单机柜功率密度成为了调和不断增长的算力需求和有限的数据中心承载能力的关键解决方案。根据数据,2020年全球数据中心单机柜平均功率将达16.5kW,相比2008年提升175%,并且到2025年单柜功率有望进一步提升至25kW。

国内更高单机柜功率数据中心占比逐年提升。根据CDCC统计数据,2021年国内全行业数据中心单机柜平均功率密度中8-12kW占比8%、12-20kW占比3%;2022年国内全行业数据中心单机柜平均功率密度中8-12kW占比15%,同比增长7pct,12-20kW占比10%,同比增长7pct。在高功率数据中心机柜占比迅速增加的背景下,对设备散热冷却提出了更高的要求。液冷数据中心适合提供高密算力,提升单柜部署密度,提高数据中心单位面积利用率。因此液冷技术不断渗透。

2、政策强制叠加节能效果优越,液冷大势所趋

应用液冷技术能够为数据中心节能、降噪功能。液冷数据中心节省了风冷基础设施而只增加了循环泵,不仅节省建设成本,也大大降低了能耗,使数据中心整体更节能。从成本端来看,数据中心的总成本(TCO)等于建设成本(Capex)加上运营成本(Opex),建设成本包含土建以及硬件设备所需投资,为一次性投入,而运营成本则是后续数据中心运营过程中需要持续花费的成本。

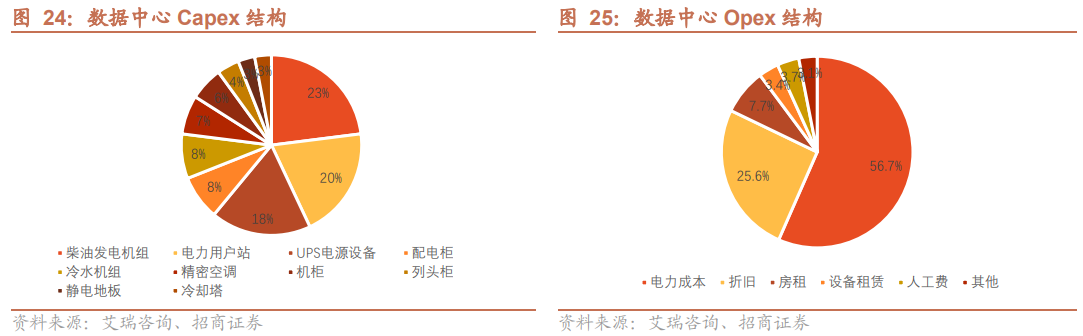

据数据,在数据中心Capex结构中,柴油发电机组成本最高,占整体比例23%,其次是电力用户站占比20%,UPS电源设备占比18%,剩余成本项占比均低于10%;

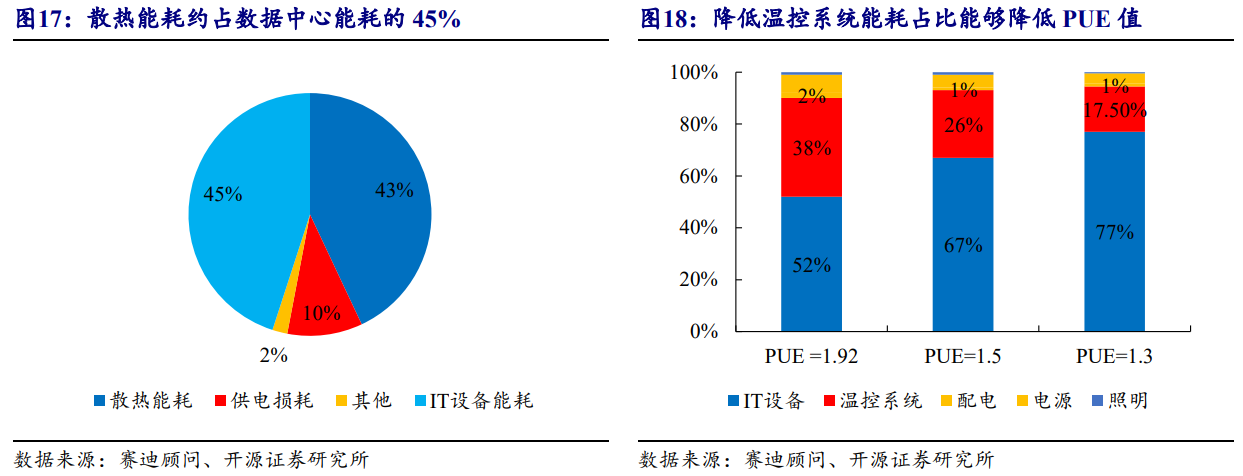

Opex结构方面,电力成本(能耗)占整体支出的一半以上,折旧其次,占比25.6%。单独将Opex中的能耗成本进行拆分来看,其中IT设备能耗最高,占整体Opex的45%,散热能耗占比43%,接近IT设备自身的能耗,供电损耗及其他占比12%,能看出散热能耗对于数据中心电力成本影响极大,随着IT相关设备功率密度的提升,对设施的散热要求也更加苛刻,因此采用高效的液冷手段是数据中心发展的必经之路。

根据PUE的计算公式(数据中心总能耗/IT设备能耗),降低制冷系统的能耗是降低数据中心耗能的主要措施。当温控系统对应的能耗占比分别为38%、26%、17.5%时,对应的PUE为1.92、1.5、1.3。

国家和部分地方层面对新建数据中心均提出了PUE指标方面的要求。根据工信部发布的《新型数据中心发展三年行动计划(2021-2023年)》要求新建大型及以上数据中心PUE降低到1.3以下,严寒和寒冷地区力争降低到1.25以下,同时包括北京、上海、广东等地均对数据中心的PUE值提出了一定的限制要求。对于提出的指标要求,液体浸没冷却法可有效解决这个问题,能耗可降低90%-95%。

四、液冷行业上下游产业链及行业壁垒分析

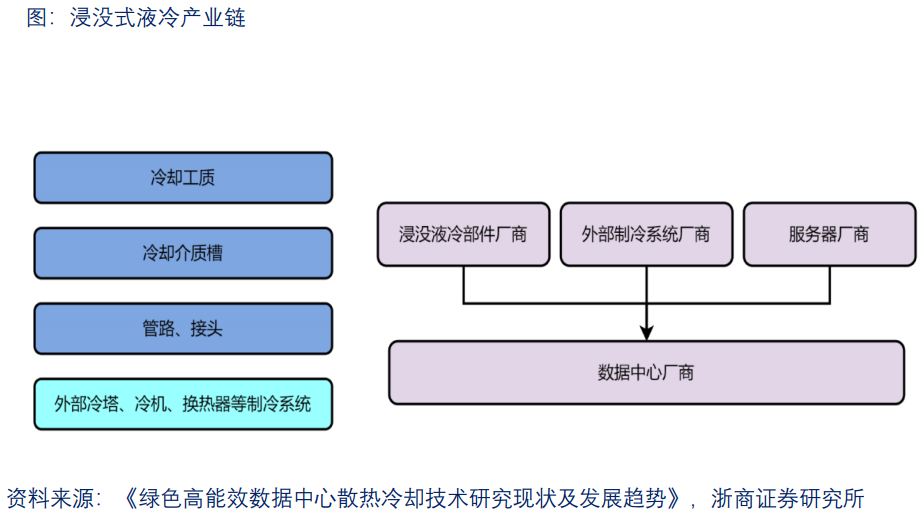

总体来看,液冷行业产业链上游主要为产品零部件,包括接头、CDU、电磁阀、TANK等。中游主要为液冷服务器,此外还包括数据中心的集成运维设施、产品及部件。服务器及相关集成产品主要用于下游行业,为云计算、人工智能及物联网等方面提供服务。国内下游行业主要包括互联网、金融、电信、政府、交通和能源等信息化程度相对较高的行业,涵盖智慧计算、电子政务、企业信息化、关键应用以及民生等相关领域,包括三大电信运营商,以及腾讯、阿里巴巴等互联网大型企业。

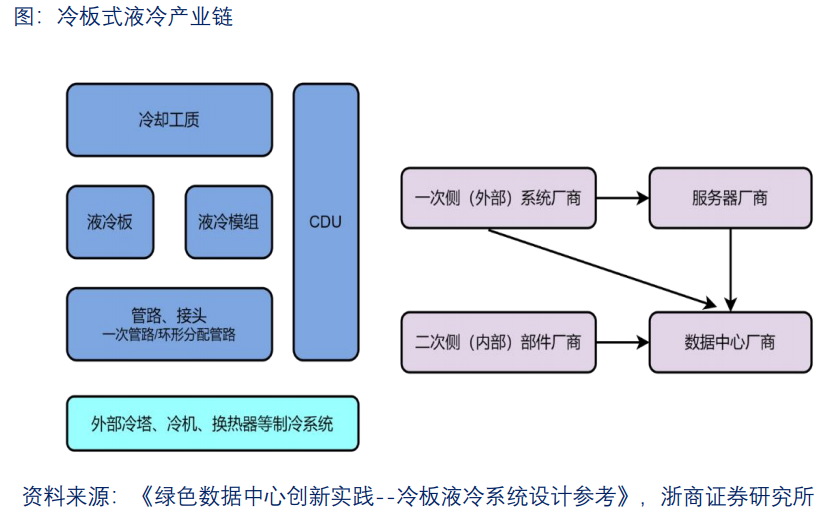

1、冷板式液冷

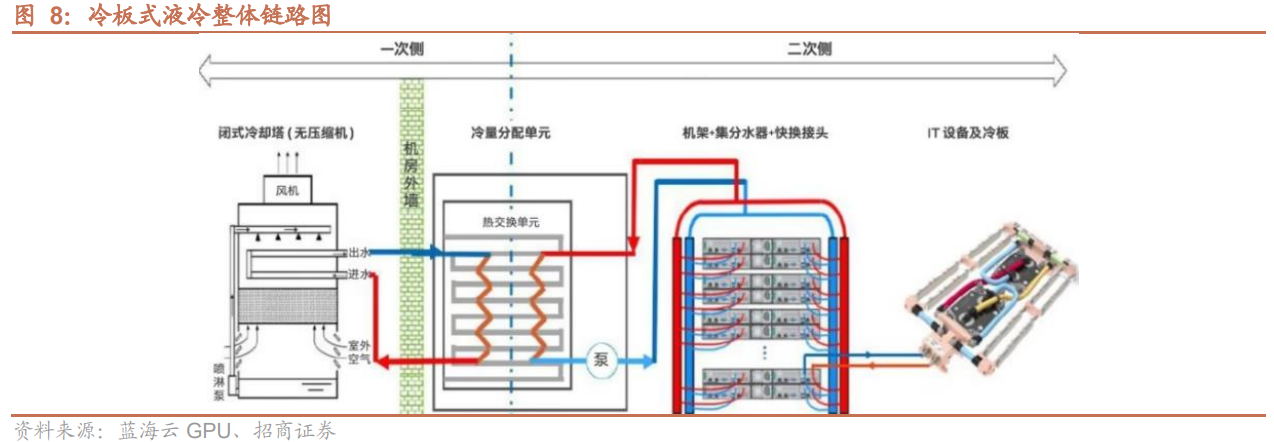

冷板式液冷是最典型的间接式接触型液冷技术。冷板式液冷系统包括了水冷板、管道、快插接头、分液器、冷却液分配单元(CDU)与室外冷却设备等组件。在冷板式液冷系统中,服务器芯片等发热器件不直接接触冷却液,而是通过与装有液体的冷板直接接触来散热,或者由导热部件将热量传导到冷板上(冷板通常是由铜、铝等高导热金属构成的封闭腔体),然后通过冷板内部液体循环带走热量。由于服务器芯片等发热器件不用直接接触液体,所以冷板式液冷对现有服务器芯片组件及附属部件改动量较小,可操作性更强、目前成熟度最高、应用最广泛。

冷板式液冷数据中心散热系统主要由由室外(一次侧)和室内(二次侧)两部分组成。一次侧通过冷却液体与发热部件的热量进行相互交换的方式降低冷却液的温度;二次侧完成发热部件与冷却液体热量的交换,液体升温带走部件热量。在运行过程中,机房外冷却塔中的冷却液通过室内冷量分配单元(CDU)提供冷却液循环动力,经其二次侧输出并与服务器中高发热量的电子元器件(CPU、GPU、内存等)导热冷板直接进行热交换,形成的热液经CDU输出到室外冷却塔进行冷却,从而构成整个循环过程,在冷板式液冷散热方式中,硬盘、电源等发热量较小的器件或单元仍旧采用风冷方式散热。

2、浸没式液冷

浸没式液冷是最常见的直接接触型液冷技术。该技术通过将发热器件直接浸没于特殊定制的箱体中,通过直接接触不导电的冷却液体进行热交换,从而达到冷却目的,相比冷板式液冷技术,浸没式液冷散热效率更高,噪音更低(完全没有风扇),更加节能。

(1)单相浸没式

单相浸没式液冷中冷却液不会发生相变。单相浸没在浸没式单相液冷中,发热部件直接浸没在冷却液中进行热交换,循环泵将吸收了热量的冷却液导入热交换单元,在热交换单元中冷却后再循环回到箱体中为发热部件散热,冷却液在循环散热过程中始终保持液相。

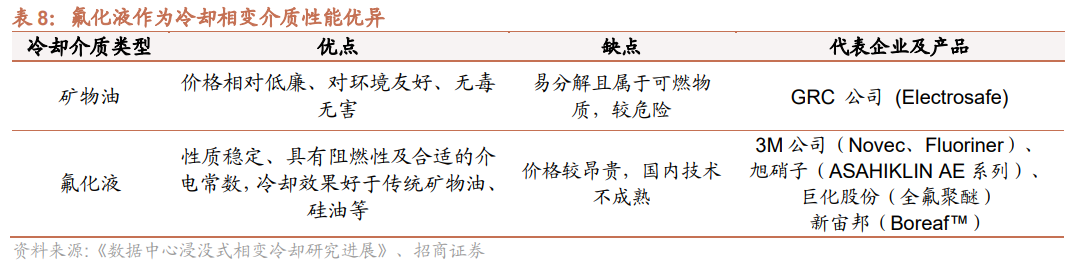

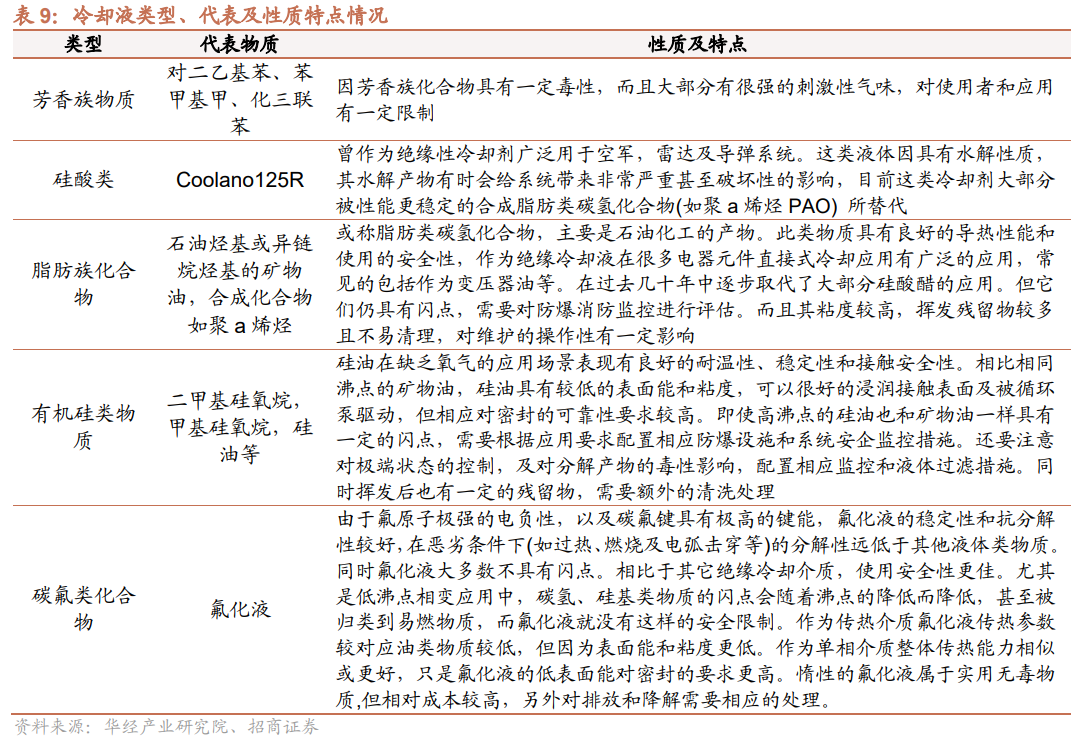

由于要确保冷却液不发生气化,单相浸没技术通常需要使用高沸点的冷却液,例如氟化学物质(或氟碳化合物)、烃类(例如矿物油、合成油和天然油)以及碳氢化合物。冷却液挥发流失控制相对简单,与IT设备有较好的电气兼容性,且不需要频繁补充,还易于卸载或更换服务器组件,提高了系统的可维护性。

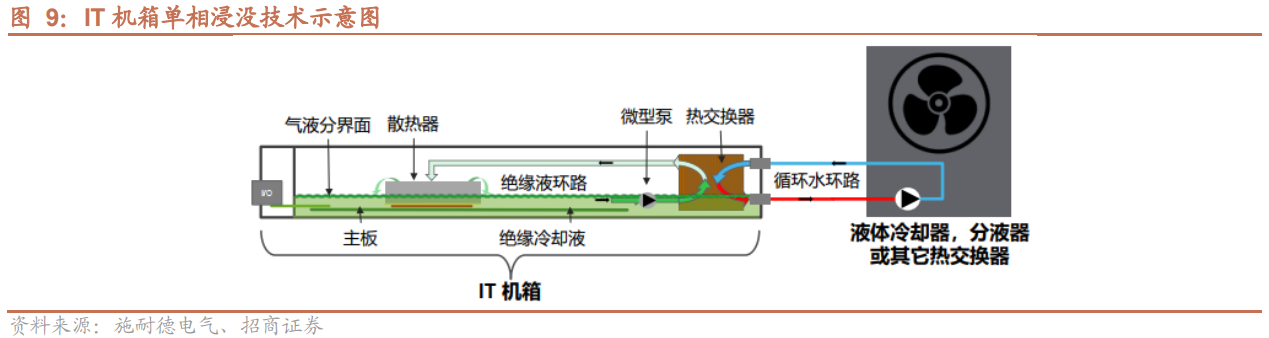

1)IT机箱单相浸没

该技术将服务器封装于密封机箱中,可作为普通机架式IT设备或独立设备,电子元器件由绝缘液进行冷却,可通过自然对流、循环泵或者两者结合的方式进行冷却,换热器和泵可置于服务器内部,也可以安装在侧面。

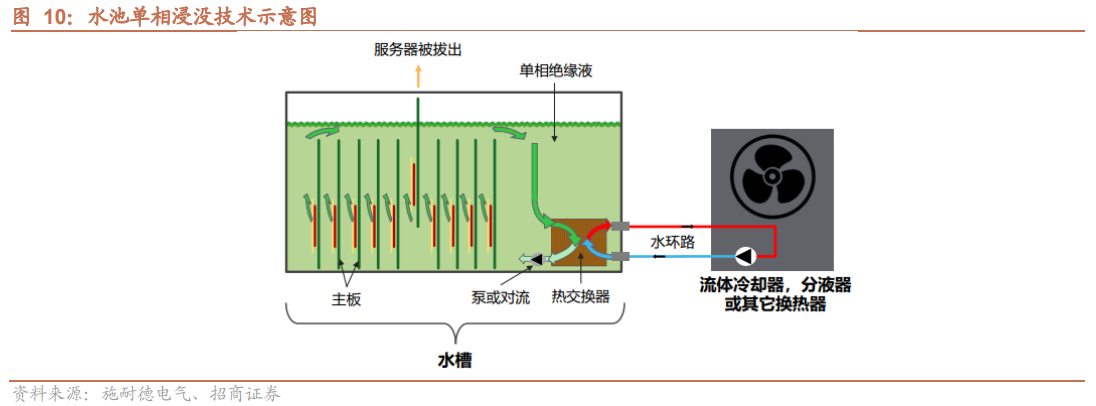

2)水池单相浸没

使用水池方法(开放式水箱)时,浸没在水池中的服务器是通过垂直方式进行插拔的,这种方法多数采用集中式供电,同时向水池内的所有服务器供电,可通过自然对流、循环泵进行冷却,通过换热器将绝缘液中的热量传递至水回路,此方法通常使用油基绝缘液作为流体。

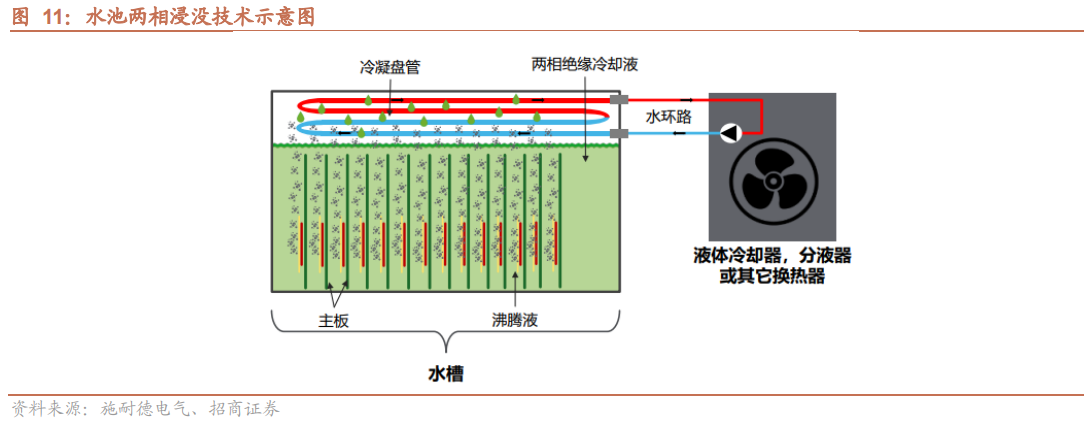

(2)两相浸没式

两相浸没式液冷的冷却液在循环散热过程中,会不断经历从液态到气态,再从气态回到液态的相变。服务器完全浸没在充满低沸点冷却液的密闭箱体中,冷却液受热沸腾发生相变,蒸汽逃逸并升腾至机箱顶部形成气相区,而后蒸汽遇到冷凝器再液化变为液体,继续回到箱体内部冷却循环。

用于两相浸没式的冷却液需要有更稳定的物理特性。由于冷却液再热循环过程中不断发生相变,因此冷却液需要有良好的化学及热稳定性、无腐蚀性,并且需要合适的沸点、较窄的沸程范围和较高的汽化潜热,硅酸酯类、芳香族物质、有机硅、脂肪族化合物以及氟碳化合物均可用作冷却液。

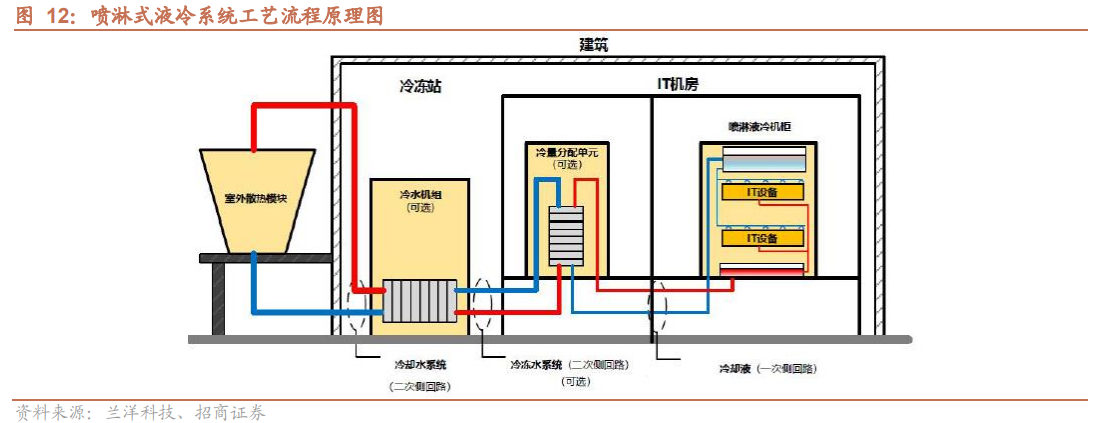

3、喷淋式液冷

喷淋式液冷系统是一种面向电子设备器件精准喷淋、直接接触式的液冷技术。喷淋式液冷系统主要由冷却塔、冷水机组、CDU、喷淋液冷机柜构成,冷却液经过CDU后被泵通过管路输送至机柜内部,进入机柜后直接通过分液支管进入与服务器相对应的布液装置,或者送至储液箱以通过重力或系统压力直接喷淋至IT设备的发热器件或与之连接的固体导热材料上(金属散热器、树脂(VC)、热管等),吸热后的高温冷却液换热后将通过回液管、集液箱等集液装置进行收集并通过泵输送至CDU进行下一次制冷循环。喷淋式液冷与单相浸没式液冷冷却方式较为类似,冷却液不发生相变,但是在喷淋过程中遇到高温的电子部件冷却液会出现飘逸,从而对机房及设备环境产生影响。

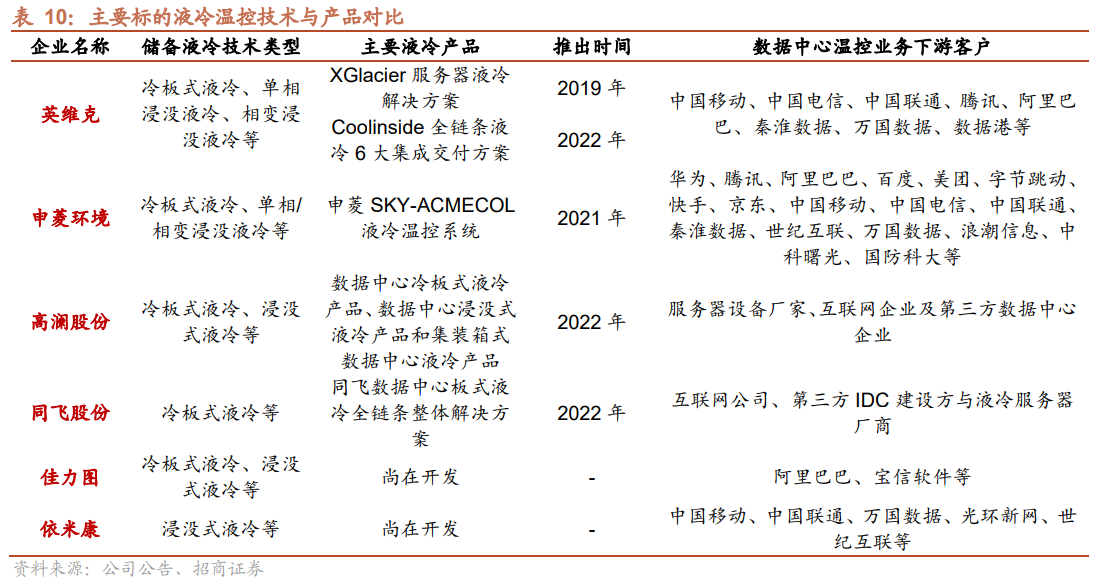

国内液冷温控解决方案公司主要包括英维克、申菱环境、高澜股份、同飞股份、佳力图、依米康等。

4、行业壁垒

行业具有较高的进入壁垒,先进入者具备先发优势。(1)技术壁垒。液冷数据中心基础设施产品的研发和制造涉及冷却技术、制冷系统设计及仿真技术、温湿度解耦控制算法等多项技术领域,要求企业具备成熟、深入的技术积累。(2)专业人才壁垒。液冷数据中心基础设施领域属于新兴技术密集型产业,产品性能涉及材料化学、热力学、电子学、计算机科学等多种学科技术成果,并且因数据中心复杂多样,相应的制冷系统存在定制化特征,因此对研发技术人员的技术研发能力和行业经验要求较高。(3)客户认证壁垒。出于安全性、稳定性等考虑,企业客户在选择液冷数据中心基础设施供应商时通常需要进行严格的资质验证。另一方面,客户在与液冷数据中心基础设施供应商建立生产配套关系后,倾向于维持与现有技术供应商的合作,不会轻易更换主要供应商,因此先进入者具有先发优势。

五、液冷市场未来展望

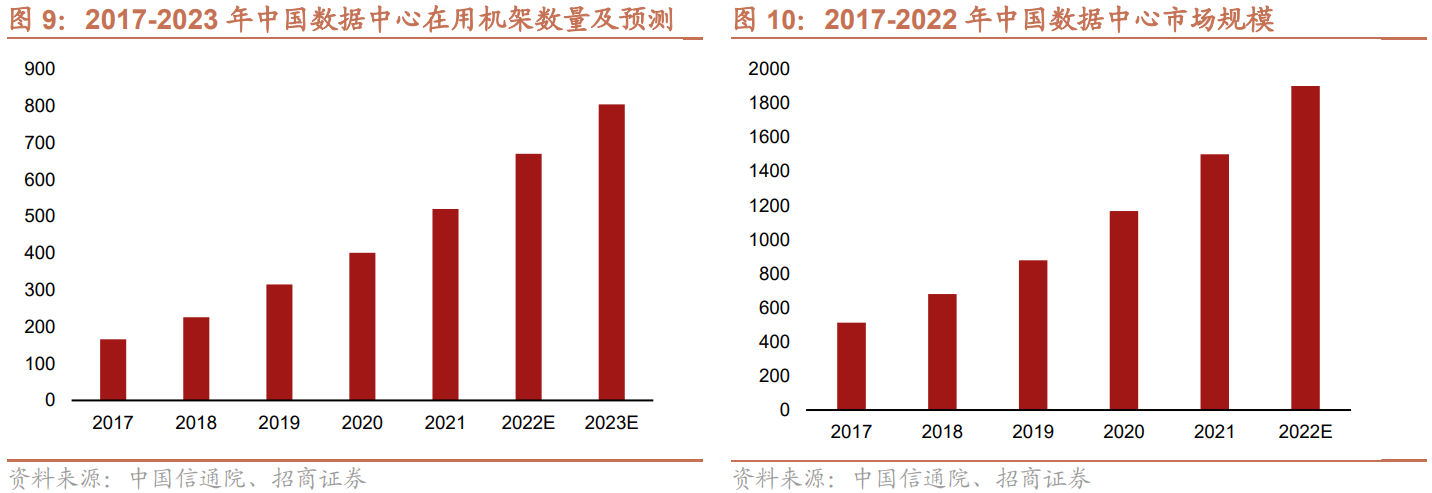

近年来,国内数据中心建设加快推进。根据中国信通院的数据显示,2021年,中国数据中心在用机架数量达到520万架,较2020年增加超过100万架。据工信部《新型数据中心发展三年行动计划(2021-2023年)》,预计到2023年底,全国数据中心机架规模年均增速保持在20%左右,2023年中国数据中心在用数量将超过800万架。2021年中国数据中心市场规模超过1500亿元,2022年中国数据中心市场规模突破1900亿元人民币,同样呈现出较快的增长趋势。

预计2025年中国液冷数据中心市场规模将超千亿。据《液冷白皮书》,考虑到液冷对传统市场进行替代,包括风冷的机房空调市场、服务器市场以及数据中心基础设施(机柜、CDU、冷却塔等)市场,预计2025年,保守测算下中国液冷数据中心市场规模将达1283.2亿元,乐观测算下中国液冷数据中心市场规模将达1330.3亿元。

浸没式液冷凭借其优良的制冷效果,市场份额将快速提升。据《液冷白皮书》,保守来看,2025年中国冷板式液冷数据中心市场规模将达到757.1亿元,浸没式为526.1亿元;乐观来看,2025年中国冷板式液冷数据中心市场规模将达到784.9亿元,浸没式为545.4亿元。其中浸没式液冷数据中心凭借其优良的制冷效果,市场份额增长速度较快。

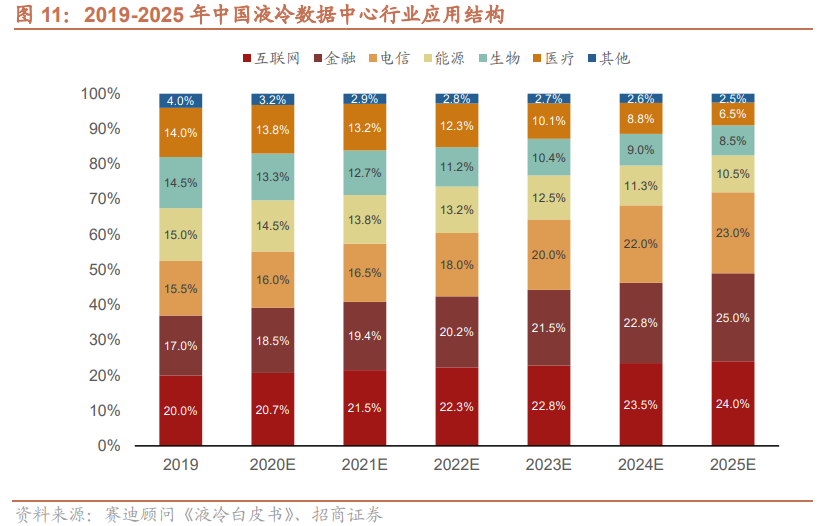

互联网、金融、电信等领域对数据中心液冷的需求量将会持续加大。预计到2025年,互联网行业液冷数据中心占比将达到24.0%,金融行业将达到25.0%,电信行业将达到23.0%。而能源、生物、医疗和政务等将行业需求将加快融入通用数据中心新业态,整体上规模有所下降。预计2025年能源行业液冷数据中心占比将达到10.5%,金融行业将达到8.5%,电信行业将达到6.5%,以政务为代表的其他业务将下降至2.5%。

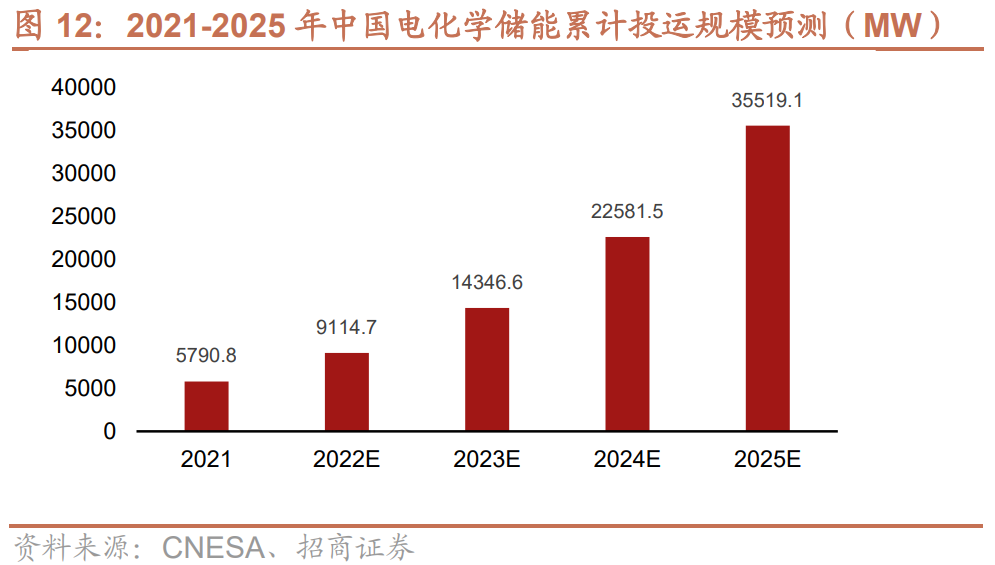

除数据中心之外,近年来电化学储能市场快速发展,预计将带动储能温控行业需求提升。据CNESA数据,截至2021年底,我国已投运储能项目累计装机规模为46.1GW,占全球市场总规模的22%,同比增长30%,由于储能电池容量及功率较大,其对散热要求更高,同时储能系统内部容易产生电池产热和温度分布不均等问题,优质的温控系统显得对电池系统的寿命和安全性显得尤为重要。

来源:网络 兰洋科技编辑整理

本文标题:2023年数据中心液冷行业发展现状及趋势深度分析

本文链接:https://www.blueocean-china.net/faq3/533.html [版权声明]除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。